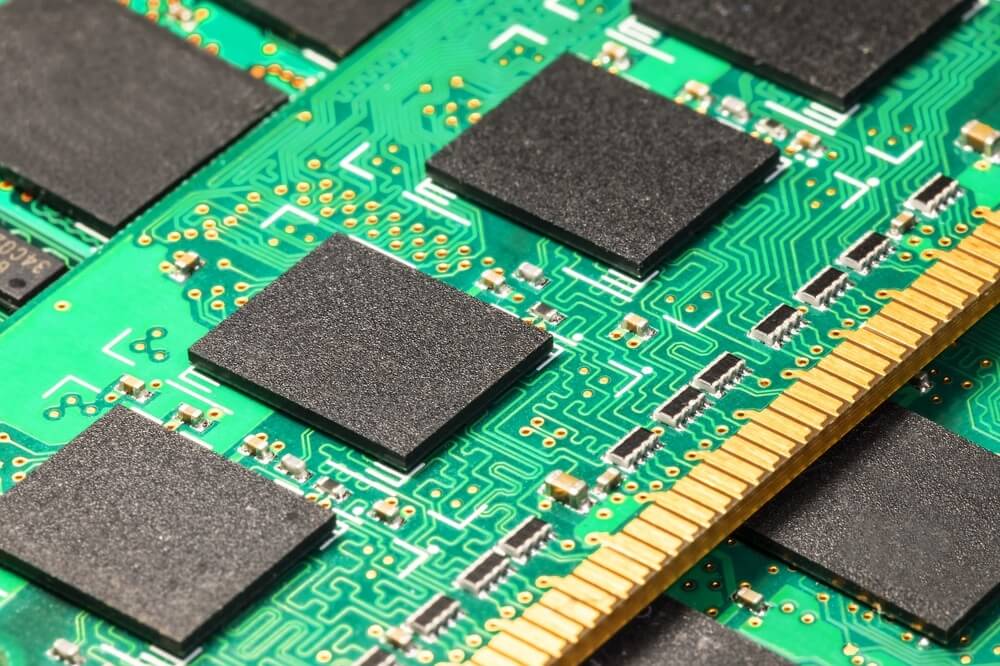

Làn sóng trí tuệ nhân tạo không chỉ làm bùng nổ nhu cầu GPU mà đang kéo theo một hệ quả lớn hơn: cơn khát bộ nhớ DRAM chưa từng có.

Theo các nguồn tin trong ngành, các hãng sản xuất CPU đang tính đến việc trang bị từ 300 đến 400 GB DRAM cho mỗi bộ xử lý phục vụ AI – con số vượt xa mức 96 – 256 GB vốn phổ biến trước đây. Diễn biến này được dự báo sẽ đẩy thị trường DRAM vào tình trạng căng thẳng kéo dài ít nhất đến năm 2027.

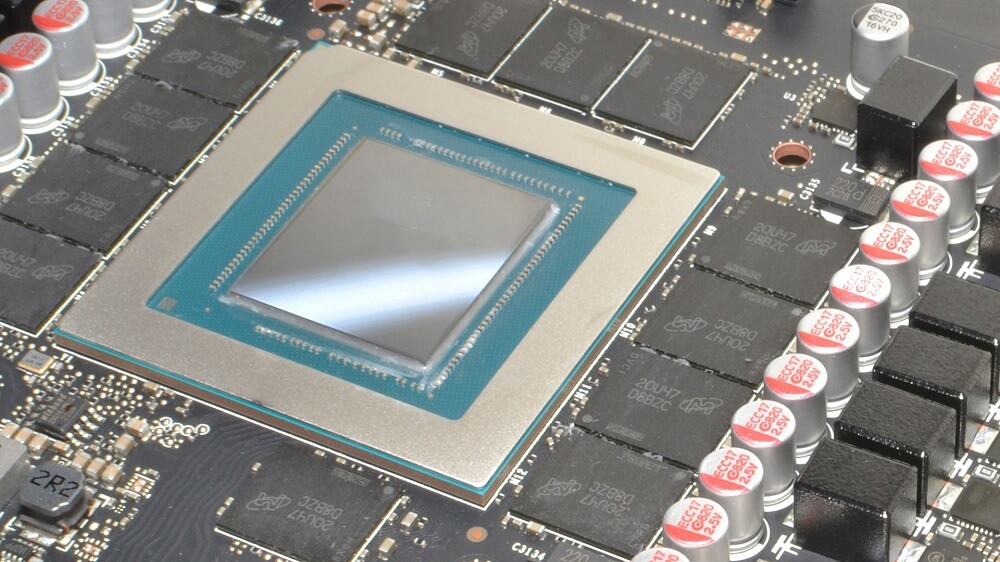

CPU không còn “vai phụ” trong kỷ nguyên AI

Trước đây, hạ tầng AI gần như xoay quanh GPU, với tỷ lệ GPU/CPU có thể lên tới 8:1. Tuy nhiên, sự xuất hiện của các mô hình Agentic AI – vốn yêu cầu khả năng xử lý linh hoạt, đa nhiệm và kiểm soát luồng dữ liệu phức tạp – đang khiến vai trò của CPU thay đổi rõ rệt. Tỷ lệ này hiện đã giảm xuống khoảng 4:1 và có thể tiến gần mức 1:1 trong tương lai.

Điều đó đồng nghĩa với việc CPU không còn chỉ đóng vai trò hỗ trợ mà trở thành một thành phần tính toán quan trọng trong hệ thống trí tuệ nhân tạo. Khi CPU phải xử lý nhiều tác vụ hơn, nhu cầu bộ nhớ dung lượng lớn và băng thông cao cũng tăng theo cấp số nhân.

Cuộc đua dung lượng bộ nhớ lan rộng toàn ngành

Áp lực không chỉ dừng ở CPU. Trong khi các nền tảng máy chủ bắt đầu hướng tới mức 300 – 400 GB DRAM mỗi CPU, các hãng chip lớn cũng đang đẩy giới hạn bộ nhớ trên GPU và TPU lên mức mới. NVIDIA được cho là sẽ ra mắt kiến trúc Vera Rubin với 288 GB HBM, trong khi AMD đang phát triển GPU MI400 với dung lượng có thể lên tới 432 GB. Ở phía Google, TPU thế hệ mới cũng chạm mốc 288 GB bộ nhớ băng thông cao.

Điểm đáng chú ý là cuộc đua này không chỉ nhằm tăng dung lượng, mà còn tập trung vào băng thông và độ trễ – hai yếu tố sống còn trong xử lý AI. Các chuẩn bộ nhớ mới như HBM4, MRDIMM hay thậm chí các giải pháp đóng gói bộ nhớ trực tiếp lên CPU (HBM on package) đang được nghiên cứu để đáp ứng nhu cầu này.

Nguồn cung chưa theo kịp, nguy cơ thiếu hụt kéo dài

Trong khi nhu cầu tăng vọt, năng lực sản xuất lại không thể mở rộng ngay lập tức. Các nhà máy bán dẫn cần nhiều năm để xây dựng và vận hành, khiến nguồn cung DRAM khó bắt kịp tốc độ phát triển của AI.

Các hãng như Samsung hay SK Hynix đang đẩy mạnh đầu tư, nhưng ngay cả những kế hoạch này cũng chưa thể giải quyết bài toán trong ngắn hạn. Thậm chí, một số dự báo cho rằng tình trạng thiếu hụt DRAM vào năm 2027 có thể còn nghiêm trọng hơn hiện tại.

Một hệ quả rõ ràng là các nhà sản xuất đang ưu tiên nguồn lực cho các dòng bộ nhớ cao cấp phục vụ AI – nơi biên lợi nhuận cao hơn. Điều này dẫn đến việc các dòng DRAM phổ thông bị giảm sản lượng, kéo theo nguy cơ tăng giá trên diện rộng, không chỉ ở máy chủ mà cả PC – máy tính cá nhân và thiết bị tiêu dùng.

Khi AI định hình lại toàn bộ chuỗi cung ứng

Việc CPU cần tới hàng trăm GB RAM không chỉ là câu chuyện kỹ thuật, mà còn phản ánh sự thay đổi cấu trúc của toàn ngành công nghiệp bán dẫn. Từ GPU, CPU cho đến bộ nhớ, mọi thành phần đều đang được tái thiết kế để phục vụ AI.

Trong bối cảnh đó, DRAM không còn là linh kiện “phụ trợ” mà trở thành một trong những yếu tố quyết định hiệu năng hệ thống. Khi nhu cầu tiếp tục tăng và nguồn cung chưa thể mở rộng tương ứng, thị trường bộ nhớ nhiều khả năng sẽ còn biến động mạnh trong những năm tới.

Nếu xu hướng hiện tại tiếp diễn, người dùng phổ thông cũng sẽ sớm cảm nhận rõ tác động – từ giá RAM, SSD cho đến chi phí sở hữu một chiếc PC hoặc máy chủ AI trong tương lai.