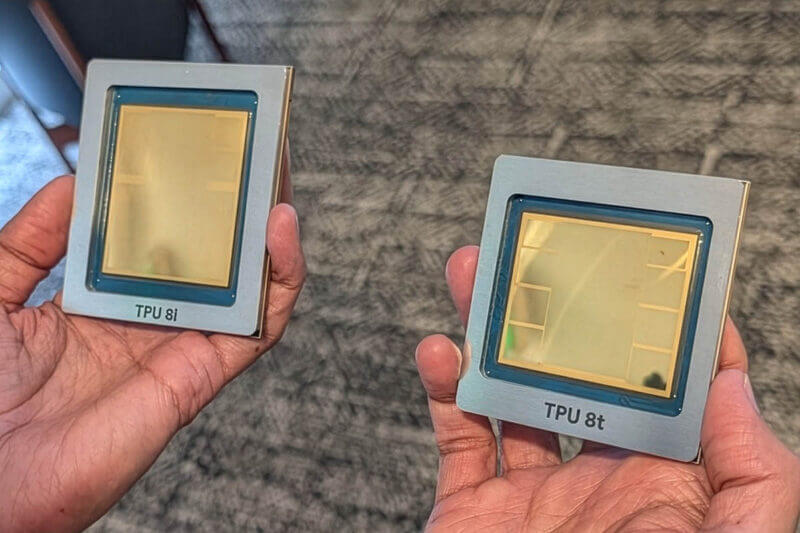

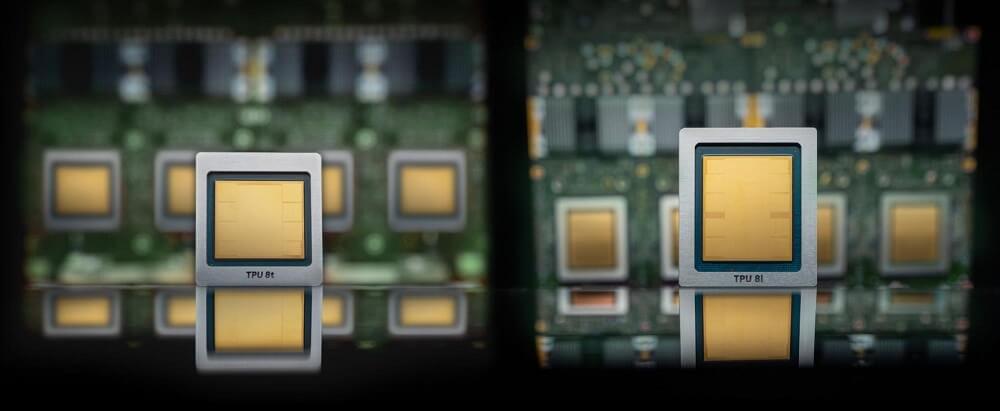

Google vừa công bố hai phiên bản bộ xử lý tensor (TPU) mới gồm TPU 8t và TPU 8i, đánh dấu bước tiến lớn trong chiến lược tự chủ phần cứng AI. Hai con chip này được thiết kế tách biệt rõ ràng cho hai giai đoạn quan trọng của AI: huấn luyện mô hình và suy luận.

TPU 8t: “siêu cụm” huấn luyện AI quy mô exaflop

TPU 8t được Google định vị là nền tảng dành cho huấn luyện AI quy mô lớn, với hiệu năng tăng gần ba lần so với thế hệ trước.

Điểm nổi bật nhất nằm ở quy mô triển khai: một cụm TPU 8t có thể tích hợp tới 9.600 chip, đạt năng lực tính toán 121 exaflop – mức sức mạnh vốn chỉ xuất hiện trong các siêu máy tính hàng đầu thế giới. Hệ thống này đi kèm 2 petabyte bộ nhớ dùng chung và được kết nối thông qua hạ tầng liên chip tốc độ cao (ICI).

Nhờ băng thông ICI được tăng gấp đôi, Google cho biết các mô hình AI phức tạp có thể mở rộng gần như tuyến tính. Điều này giúp rút ngắn đáng kể thời gian huấn luyện, từ nhiều tháng xuống còn vài tuần. Hệ thống được điều phối bởi các nền tảng như Pathways và JAX, cho phép khai thác đồng thời hàng triệu lõi xử lý trong một cụm thống nhất.

TPU 8i: tối ưu suy luận, giảm độ trễ tối đa

Nếu TPU 8t tập trung vào huấn luyện, thì TPU 8i lại hướng đến giai đoạn suy luận – nơi yêu cầu tốc độ phản hồi nhanh và chi phí thấp. Chip này được thiết kế để phục vụ các hệ thống AI thời gian thực, đặc biệt là mô hình tác nhân (agent-based AI) và kiến trúc MoE (Mixture of Experts).

Google đã nâng cấp mạnh phần bộ nhớ SRAM trên chip tăng lên 384 MB và HBM đạt 288 GB. Nhờ đó, TPU 8i có thể lưu trữ toàn bộ bộ nhớ đệm ngay trên chip, giảm phụ thuộc vào truy xuất bên ngoài – yếu tố thường gây độ trễ.

Ngoài ra, băng thông ICI đạt 19,2 Tbps và công cụ mới Collectives Acceleration Engine (CAE) giúp giảm độ trễ tới 5 lần trong các tác vụ song song. Kết quả là hiệu suất trên mỗi USD tăng hơn 80% so với thế hệ trước – một yếu tố then chốt trong việc vận hành AI quy mô lớn.

Không thay thế, mà bổ sung cho Nvidia

Dù thông số rất ấn tượng, Google nhiều khả năng không trực tiếp cạnh tranh với Nvidia trong ngắn hạn. Thay vào đó, hãng tiếp tục chiến lược quen thuộc: kết hợp chip tự phát triển với GPU của Nvidia.

Thực tế, Google vẫn triển khai các hệ thống sử dụng GPU Nvidia trong hạ tầng Google Cloud. Gần đây, hãng cũng giới thiệu máy chủ A5X sử dụng nền tảng Vera Rubin NVL72 – dòng GPU mới của Nvidia. Điều này cho thấy TPU không nhằm thay thế hoàn toàn GPU, mà đóng vai trò tối ưu hóa chi phí và hiệu năng cho từng loại workload cụ thể.

Hệ sinh thái phần cứng AI ngày càng hoàn chỉnh

Bên cạnh TPU, Google cũng công bố loạt sản phẩm hạ tầng mới:

- Máy ảo Axion N4A với CPU Arm tự phát triển

- Google Compute Engine thế hệ mới dùng CPU x86

- Nền tảng trung tâm dữ liệu Virgo Network

- Máy ảo Z4M tối ưu lưu trữ tốc độ cao

- Google Kubernetes Engine cho workload AI

Những thành phần này cho thấy Google đang xây dựng một hệ sinh thái phần cứng – phần mềm đồng bộ, phục vụ riêng cho kỷ nguyên AI.

Cuộc đua chip AI bước sang giai đoạn mới

Sự xuất hiện của TPU 8t và 8i phản ánh xu hướng rõ rệt: các “ông lớn” công nghệ không còn phụ thuộc hoàn toàn vào nhà sản xuất chip bên ngoài. Google, Microsoft và Amazon đều đang phát triển chip riêng để giảm chi phí vận hành,t ối ưu hiệu năng theo nhu cầu và kiểm soát tốt hơn hạ tầng AI.

Dù Nvidia vẫn giữ vị thế dẫn đầu, áp lực cạnh tranh đang gia tăng khi các công ty công nghệ lớn dần tự chủ về phần cứng.

Kết luận

Với TPU 8t và 8i, Google không chỉ nâng cấp sức mạnh tính toán, mà còn định hình lại cách xây dựng hạ tầng AI: tách biệt rõ huấn luyện và suy luận, tối ưu từng khâu và kiểm soát toàn bộ hệ sinh thái.

Trong bối cảnh AI ngày càng “ngốn” tài nguyên, những bước đi như vậy có thể trở thành yếu tố quyết định trong cuộc đua công nghệ toàn cầu những năm tới.